Gli attacchi adversariali rappresentano una delle sfide più critiche per la sicurezza dell’AI moderna. Scopri come funzionano questi attacchi invisibili e le strategie di difesa che stanno ridefinendo lo sviluppo dell’intelligenza artificiale.

Nel mondo dell’intelligenza artificiale, una battaglia silenziosa si combatte ogni giorno tra sistemi di attacco e difesa sempre più sofisticati. Gli attacchi adversariali rappresentano una delle minacce più insidiose per i modelli di AI, capaci di ingannare anche i sistemi più avanzati con modifiche impercettibili all’occhio umano.

Cosa Sono gli Attacchi Adversariali

Un attacco adversariale consiste nel modificare leggermente un input in modo da causare errori di classificazione o comportamenti indesiderati nei modelli di intelligenza artificiale. Queste modifiche, chiamate perturbazioni adversariali, sono spesso così sottili da essere invisibili agli esseri umani, ma sufficienti a confondere completamente un sistema AI.

Immaginate un cartello stradale di stop che, con l’aggiunta di alcuni adesivi apparentemente innocui, viene interpretato da un’auto a guida autonoma come un segnale di limite di velocità. Questo scenario, lungi dall’essere fantascientifico, rappresenta una realtà concreta che i ricercatori stanno affrontando con urgenza crescente.

Tipologie di Minacce Adversariali

Gli attacchi adversariali si manifestano in diverse forme, ciascuna con caratteristiche e obiettivi specifici:

- Attacchi White-box: L’attaccante ha accesso completo al modello target, inclusi parametri e architettura

- Attacchi Black-box: L’attaccante può solo osservare gli output del sistema senza conoscerne la struttura interna

- Attacchi fisici: Modifiche applicate nel mondo reale, come adesivi su oggetti o pattern su vestiti

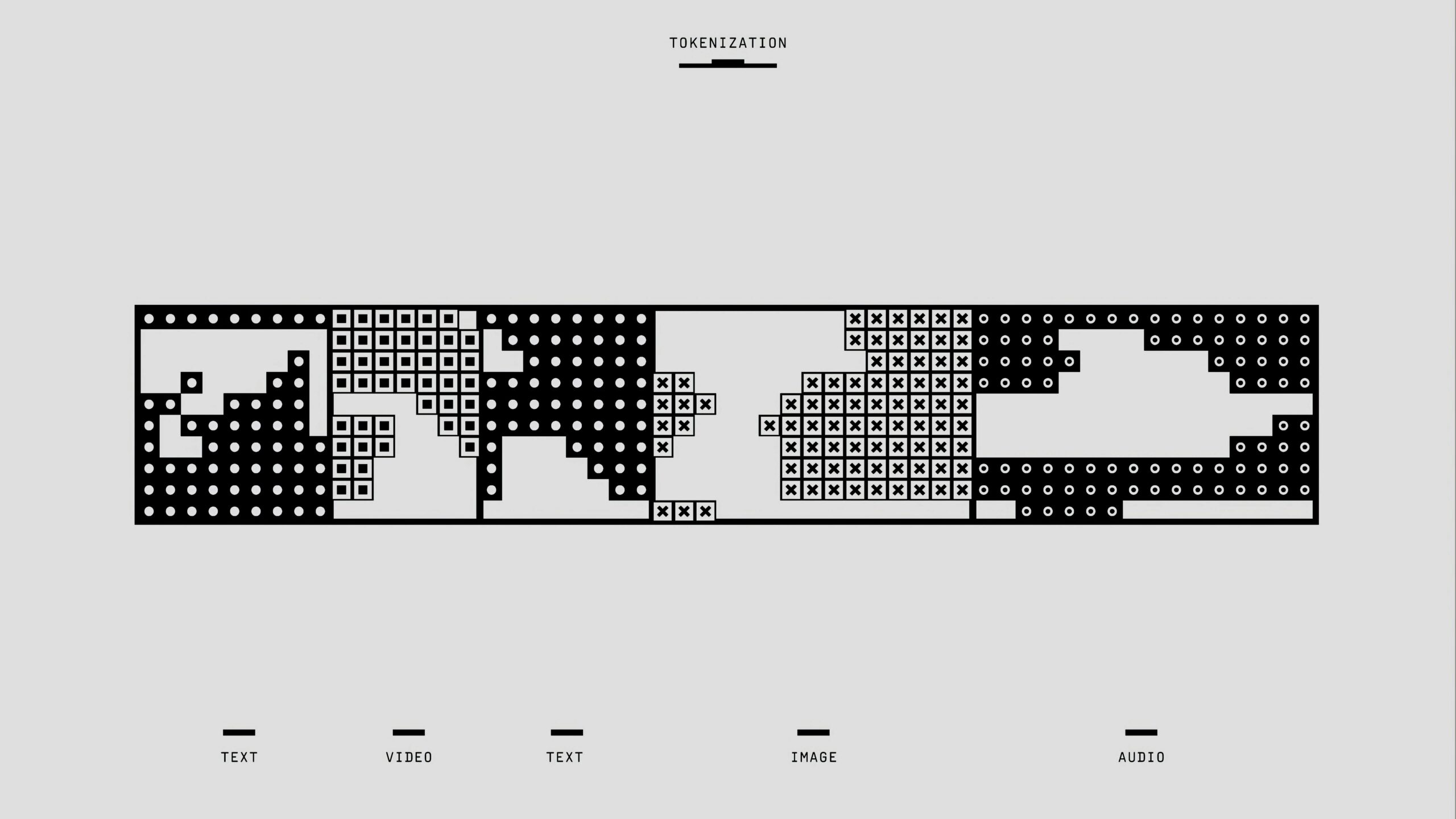

- Attacchi digitali: Manipolazioni di dati digitali come immagini, audio o testo

Settori a Rischio e Implicazioni

Le vulnerabilità adversariali hanno implicazioni particolarmente critiche in settori sensibili. Nel settore automotive, i sistemi di visione artificiale delle auto autonome potrebbero essere ingannati da modifiche strategiche alla segnaletica stradale. Nel campo della sicurezza informatica, i sistemi di riconoscimento facciale potrebbero essere elusi con pattern specifici applicati al volto.

Anche il settore medico non è immune: algoritmi di diagnosi per immagini potrebbero essere manipolati per nascondere patologie o crearne di false, con conseguenze potenzialmente fatali per i pazienti.

Strategie di Difesa e Robustezza

La ricerca in difesa adversariale si concentra su diverse strategie innovative:

- Adversarial Training: Allenare i modelli utilizzando esempi adversariali per aumentarne la robustezza

- Defensive Distillation: Tecnica che rende i modelli meno sensibili alle perturbazioni

- Certified Defenses: Metodi che garantiscono matematicamente la robustezza entro certi parametri

- Detection Systems: Algoritmi specializzati nell’identificare input adversariali

Il Futuro della Sicurezza AI

L’evoluzione degli attacchi adversariali sta spingendo l’industria dell’AI verso una maggiore consapevolezza della sicurezza. Le aziende stanno investendo massicciamente in red teaming – team dedicati a testare la robustezza dei propri sistemi – e in metodologie di sviluppo che integrano la sicurezza fin dalle fasi iniziali di progettazione.

Questa battaglia tra attacco e difesa non è destinata a concludersi presto, ma sta catalizzando innovazioni che renderanno l’intelligenza artificiale più robusta, affidabile e sicura per tutti gli utenti. La consapevolezza di queste vulnerabilità rappresenta il primo passo verso un futuro in cui l’AI potrà operare in sicurezza anche negli ambienti più critici.