L’intelligenza artificiale multimodale rappresenta la prossima frontiera dell’AI, capace di elaborare simultaneamente testo, immagini, audio e video. Questa tecnologia sta rivoluzionando il modo in cui le macchine interpretano e interagiscono con il mondo reale.

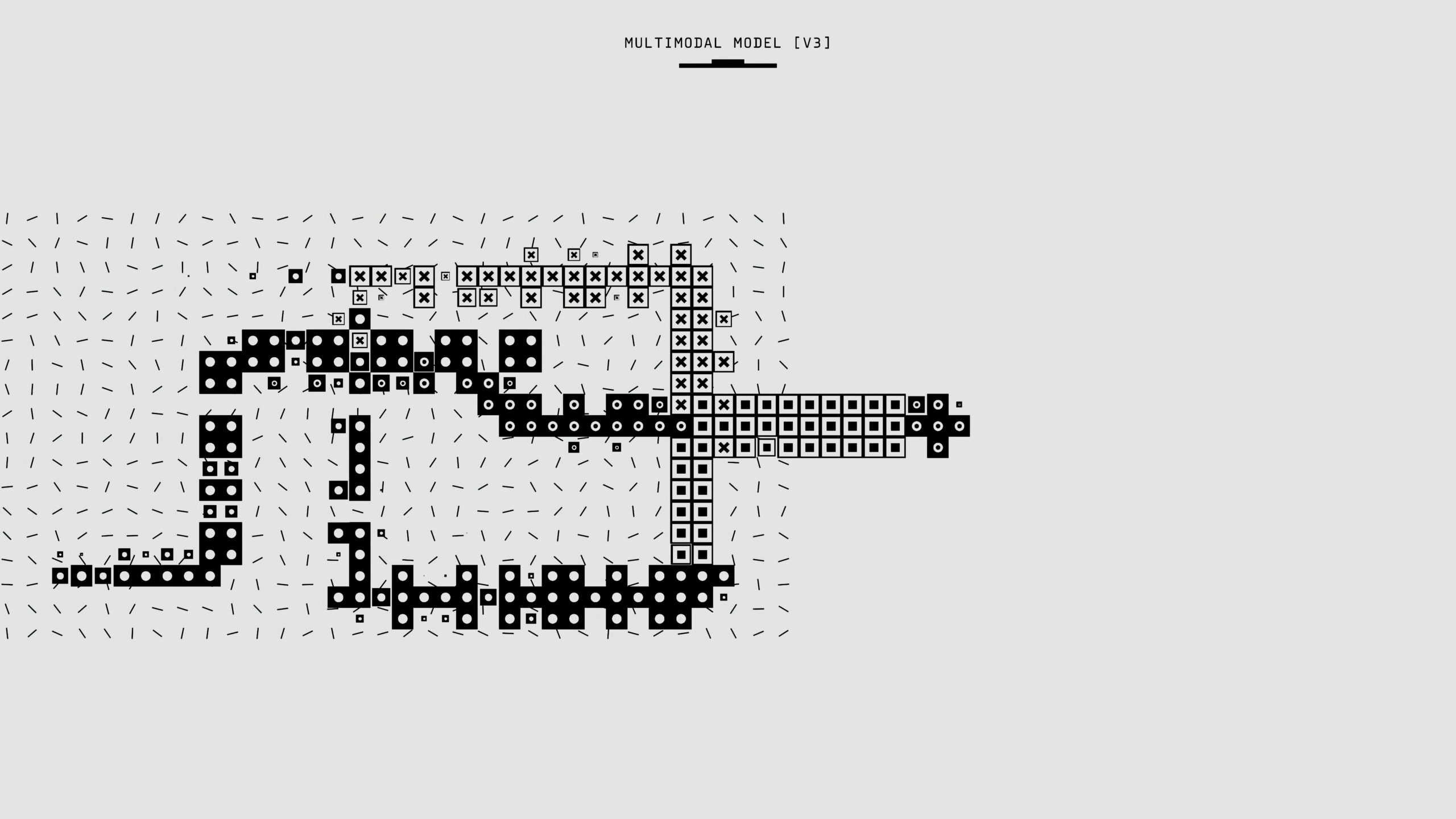

L’intelligenza artificiale multimodale sta emergendo come una delle innovazioni più promettenti nel panorama tecnologico attuale. A differenza dei sistemi AI tradizionali che si concentrano su un singolo tipo di dato, l’AI multimodale è in grado di processare e integrare simultaneamente diverse modalità di input: testo, immagini, audio, video e persino dati sensoriali.

Cosa Rende Speciale l’AI Multimodale

Il vero potere dell’AI multimodale risiede nella sua capacità di creare connessioni significative tra diversi tipi di informazioni. Quando un sistema può “vedere” un’immagine, “sentire” l’audio associato e “leggere” il testo di contesto, può sviluppare una comprensione molto più ricca e sfumata della situazione rispetto ai sistemi unimodali.

Questa integrazione multi-sensoriale replica più fedelmente il modo in cui gli esseri umani percepiscono e interpretano il mondo, rendendo l’AI più naturale e intuitiva nell’interazione con gli utenti.

Applicazioni Rivoluzionarie

Le applicazioni dell’AI multimodale stanno già trasformando diversi settori:

- Assistenti Virtuali Avanzati: capaci di comprendere comandi vocali mentre analizzano il contesto visivo dell’ambiente

- Diagnosi Medica: integrazione di immagini diagnostiche, dati clinici e sintomi descritti verbalmente

- Veicoli Autonomi: fusione di dati da telecamere, sensori, GPS e mappe per una navigazione più sicura

- E-commerce Intelligente: ricerca prodotti attraverso foto, descrizioni vocali o combinazioni di input

- Educazione Personalizzata: adattamento del contenuto basato su performance, preferenze e stili di apprendimento multimodali

Sfide Tecniche e Innovazioni

Lo sviluppo dell’AI multimodale presenta sfide uniche che i ricercatori stanno affrontando con approcci innovativi. La sincronizzazione temporale tra diverse modalità, la gestione di dati mancanti o incompleti, e l’ottimizzazione computazionale sono solo alcuni dei problemi complessi da risolvere.

Le architetture transformer, già rivoluzionarie nel campo del natural language processing, stanno mostrando risultati eccellenti anche nell’elaborazione multimodale, permettendo di creare modelli unificati capaci di gestire input eterogenei.

Il Futuro dell’Interazione Uomo-Macchina

L’AI multimodale promette di rendere l’interazione con la tecnologia più naturale e intuitiva che mai. Immaginate di poter mostrare una foto al vostro assistente AI, descrivere vocalmente cosa state cercando, e ricevere risposte contestuali che tengono conto di tutti questi elementi.

Questa evoluzione non rappresenta solo un miglioramento incrementale, ma un salto qualitativo verso sistemi AI che possono davvero comprendere e rispondere al mondo nella sua complessità multidimensionale, aprendo la strada a innovazioni che oggi possiamo solo immaginare.