L’intelligenza artificiale multimodale rappresenta il prossimo salto evolutivo nell’AI, combinando testo, immagini, audio e video per una comprensione più completa e naturale del mondo. Questa tecnologia promette di rivoluzionare l’interazione uomo-macchina e aprire nuove frontiere nell’automazione intelligente.

L’intelligenza artificiale sta compiendo un passo evolutivo fondamentale: la capacità di elaborare e comprendere simultaneamente diverse modalità di input, proprio come fa il cervello umano. L’AI multimodale rappresenta questa nuova frontiera, dove sistemi intelligenti possono processare testo, immagini, audio, video e altri tipi di dati in modo integrato e coerente.

Cos’è l’AI Multimodale

A differenza dei sistemi tradizionali che si specializzano in un singolo tipo di dato, l’AI multimodale può analizzare e correlare informazioni provenienti da diverse fonti sensoriali. Un sistema multimodale può, ad esempio, guardare un video, ascoltarne l’audio, leggere i sottotitoli e comprendere il contesto completo della scena, esattamente come farebbe un essere umano.

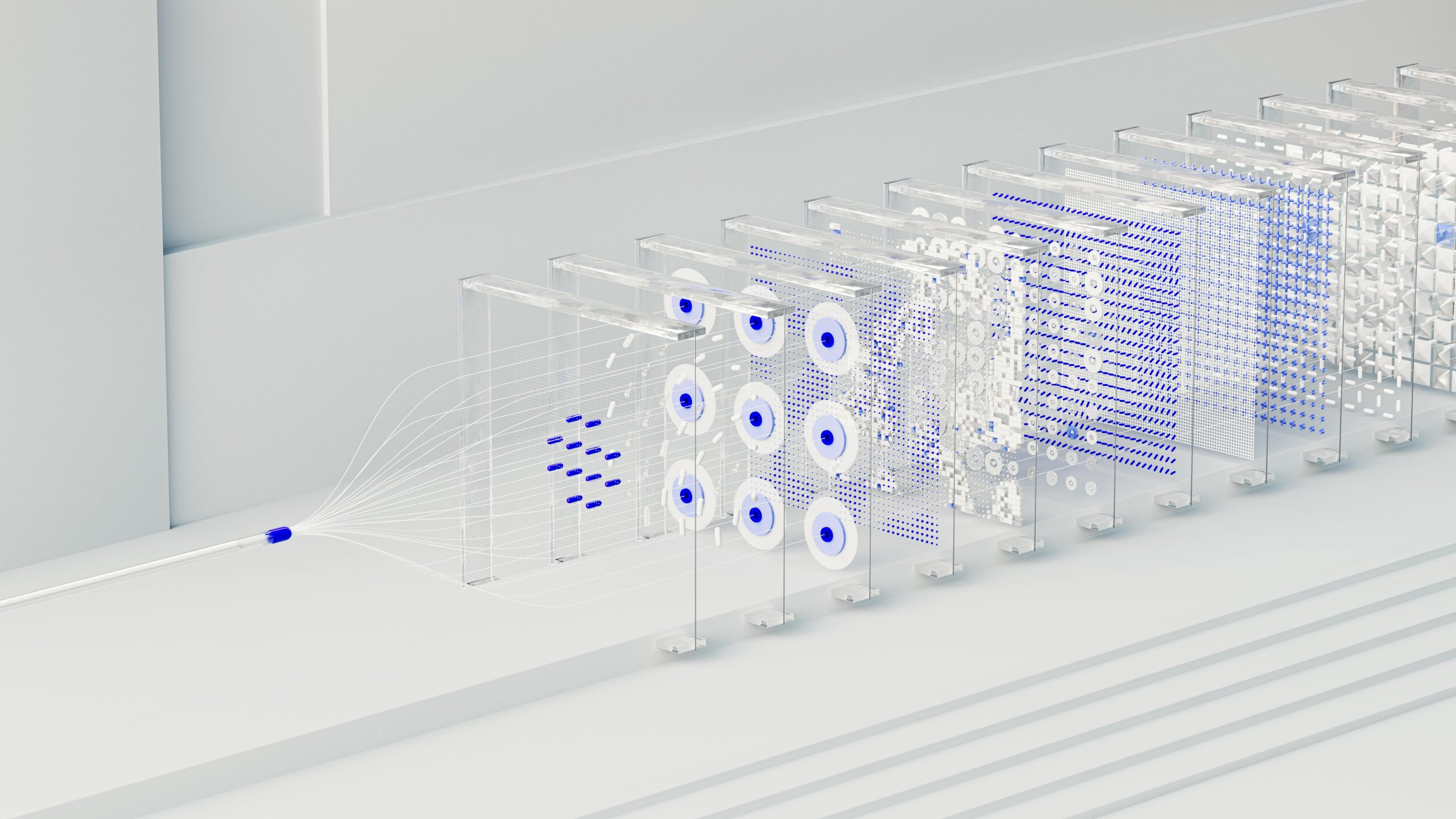

Questa capacità emerge dall’integrazione di reti neurali specializzate che lavorano in sinergia, condividendo rappresentazioni interne dei dati e creando una comprensione unificata dell’input ricevuto.

Applicazioni Rivoluzionarie

Le applicazioni dell’AI multimodale stanno già trasformando diversi settori:

- Assistenti virtuali evoluti: Sistemi che possono vedere quello che state facendo, sentire la vostra voce e rispondere in modo contestualmente appropriato

- Medicina diagnostica: Analisi simultanea di immagini mediche, sintomi descritti verbalmente e dati clinici per diagnosi più precise

- Veicoli autonomi: Elaborazione combinata di dati visivi, radar, lidar e audio per una navigazione più sicura

- Educazione personalizzata: Sistemi che adattano l’insegnamento analizzando espressioni facciali, risposte vocali e interazioni tattili

Le Sfide Tecnologiche

Sviluppare AI multimodale presenta sfide uniche. La sincronizzazione temporale tra diverse modalità, la gestione di dati eterogenei e l’allineamento semantico richiedono architetture sofisticate. I ricercatori stanno lavorando su transformer multimodali e reti di attenzione cross-modale per superare questi ostacoli.

Un’altra sfida significativa riguarda i dataset di training: creare corpus di dati che includano informazioni multimodali allineate è complesso e costoso, ma essenziale per addestrare modelli robusti.

Il Futuro dell’Interazione Uomo-Macchina

L’AI multimodale promette di rendere l’interazione con la tecnologia più naturale e intuitiva. Immaginate di poter mostrare a un sistema AI un oggetto rotto, descrivere verbalmente il problema e ricevere istruzioni di riparazione personalizzate, complete di diagrammi e video esplicativi.

Questa tecnologia sta anche aprendo nuove possibilità nella realtà aumentata e nella robotica sociale, dove la comprensione multimodale è essenziale per creare esperienze coinvolgenti e interazioni naturali.

Mentre continuiamo a perfezionare queste tecnologie, l’AI multimodale si profila come il ponte verso un futuro dove le macchine non solo processano informazioni, ma comprendono davvero il mondo nella sua ricchezza multisensoriale.